Sich in einer fremden Umgebung zurechtzufinden, stellt für blinde und sehbehinderte Menschen eine besondere Herausforderung dar. Moderne Navigationsgeräte können ihnen bei der Orientierung helfen – wenn sie genau genug arbeiten und ihre Informationen blindengerecht ausgeben. Ein Prototyp eines solchen Systems ist jetzt getestet worden.

Wissenschaftler des Instituts für Visualisierung und Interaktive Systeme (VIS) der Universität Stuttgart um Professor Thomas Ertl entwickelten eine mobile Navigationshilfe, in der lokale Sensorinformationen und Daten aus Umgebungsmodellen kombiniert werden, um eine möglichste genaue Positionsangabe zu ermögichen. Das Systrem führt bei Eingabe eines gewünschten Ziels eine blindengerechte Routenplanung durch und leitet die Anwender unter ständigem Abgleich von Sensor- und Modellinformation auch an Hindernissen vorbei.

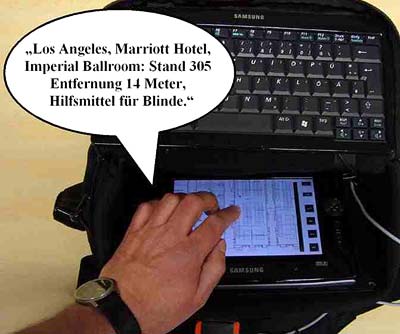

Im Gegensatz zu vielen anderen Geräten braucht für den bereits realisierten Prototyp TANIA (Tactile-Acoustical Navigation and Information Assistant), die Umgebung nicht mit einer besonderen Infrastruktur wie Sensoren ausgestattet oder mit GPS erfassbar zu sein. Die Nutzer berühren einfach einen Touchscreen und erfahren akustisch gleich, wo sie sind und was sich in der näheren Umgebung befindet. Dabei wird die aktuelle Position über ein Schritterkennungsverfahren und durch Synchronisierungen mit dem Umgebungsmodell ermittelt. Der Nutzer kann das Umgebungsmodell durch eigene Hinweise ergänzen und aktualisieren.

Einen ersten Praxistest hat das neue System bereits erfolgreich bestanden: Für eine Konferenz in Los Angeles im März dieses Jahres, bei der Technologien für Menschen mit Behinderungen im Mittelpunkt standen, fütterten die Forscher TANIA mit den Daten der Konferenzumgebung und mit Informationen zu Ausstellern und Hotelinfrastruktur. Blinde und Sehbehinderte, die den Prototyp im Rahmen der Koferenz testeten, bewerteten ihn sehr positiv.

(Universität Stuttgart, 11.07.2007 – NPO)