Mehr Simulation heißt auch mehr Speicherbedarf – normalerweise. Dank einer neuen Komprimierungs-Software ist das beispielsweise für Crash- und Wettersimulationen kein Problem mehr: Denn die Datenberge werden auf bis ein Zehntel ihrer ursprünglichen Größe geschrumpft.

Hilfe für den Wetterbericht

„Lassen Sie uns über das Wetter sprechen“, sagt Clemens-August Thole vom Fraunhofer-Institut für Algorithmen und Wissenschaftliches Rechnen SCAI in St. Augustin: „Ab 2008 wird beim Deutschen Wetterdienst die Prognose für die kommenden Tage etwa 20 Mal vorausberechnet. Da entstehen im Jahr etwa 2,5 Petabyte an Daten.“ Ein Petabyte entspricht etwa 2.000 Festplatten mit 500 Gigabyte Speicherplatz. Um diese Menge klein zu kriegen, hat Thole mit seinem Team eine Software entwickelt, die Wetterdaten im Grib-Format um den Faktor 2,5 reduzieren.

„Für die Simulationen wird Deutschland mit einen Netz von Gitterpunkten überzogen“, so sein Kollege Professor Rudolph Lorentz. „Die Simulationsergebnisse an benachbarten Punkten sind nicht unabhängig voneinander. So reicht es, wenn wir die Werte an einem Gitterpunkt gut vorhersagen können, um die Datengröße wesentlich zu reduzieren.“

…und Crashtests der Automobilindustrie

Auch aus der Automobilindustrie sind Simulationen nicht mehr wegzudenken. Allerdings benötigt bereits ein virtueller Crash mehrere Gigabyte Speicherplatz. „Pro Tag fährt so ein Modell etwa 100 bis 150 Mal im Rechner gegen die Wand“, sagt Rodrigo Iza-Teran. Da kommen schnell Daten von 100 Terabyte und mehr zusammen.

Als ersten Schritt für die Kompression geben die Entwicklungs-Ingenieure die Genauigkeit der gespeicherten Daten vor, zum Beispiel ein Millimeter für Fahrzeugcrashs. Bei diesem Quantisieren wird bewusst ein Datenverlust in Kauf genommen. Alle weiteren Komprimierungsschritte sind verlustfrei, das heißt die Daten lassen sich wieder 1:1 herstellen. Je nach Anwenderbedarf können die Wissenschaftler von SCAI eine Kompression um den Faktor 10, 7 oder 5 anbieten. „Der Ansatz ähnelt der Videocodierung“, sagt Thole. „Ein Trick besteht darin, zu ermitteln welche Bauteile sich bewegen ohne sich zu deformieren. Ein anderer ist, die sich verändernden Inhalte möglichst gut vorherzusagen.“

Fast alle deutschen Automobilhersteller setzen die Software ein. Grund: Sie sparen wertvollen Speicherplatz und der Datenaustausch läuft reibungslos. Zudem lassen sich komprimierte Daten einfacher und schneller visualisieren. Die Dekompression ist mittlerweile in viele Postprocessoren integriert, so dass sich die Files ohne einen Zwischenschritt zum Entzippen öffnen.

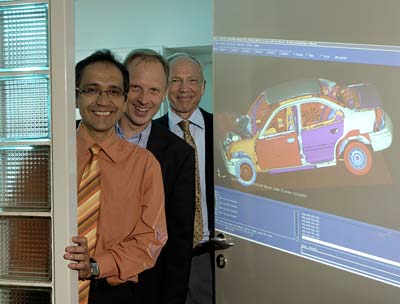

Für ihre Entwicklung zur Kompression von Simulationsergebnissen erhalten Rodrigo Iza-Teran, Prof. Dr. Rudolph Lorentz und Clemens- August Thole den Joseph-von-Fraunhofer-Preis 2007. Die Jury überzeugte zum einen die hervorragenden mathematischen Methoden und zum anderen der große Erfolg, den die Kompressionsverfahren bei den Anwendern erzielt haben.

(Fraunhofer-Gesellschaft, 12.10.2007 – NPO)