Sich mit einem Computer zu verständigen, ist nicht immer einfach. In Zukunft könnte dies anders werden: Auf der CeBIT präsentieren Fraunhofer-Wissenschaftler neue Möglichkeiten der Mensch-Maschine-Interaktion. Sie zeigen, wie sich Computer einfach per Zeigefinger oder Gesten bedienen lassen.

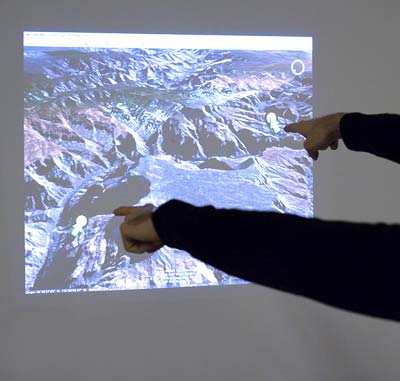

Ein Mann steht vor einem großen Bildschirm und deutet – scheinbar – hektisch herum. Wie durch Zauberhand erscheinen plötzlich Bilder auf dem Display. Ihre Bewegung folgt dem Zeigefinger des Akteurs, sie drehen sich bei einem leichten Schwenk des Fingers, vergrößern oder verkleinern sich. Wem das bekannt vorkommt, hat vielleicht den Science-Fiction Film „Minority Report“ gesehen. Ähnlich wie Tom Cruise als John Anderton agiert Paul Chojecki, Wissenschaftler am Fraunhofer-Institut für Nachrichtentechnik, Heinrich-Hertz-Institut HHI in Berlin, wenn er den iPoint Presenter erklärt.

Kamera überträgt Handbewegungen

Herzstück des Systems sind Kameras. Mit ihrer Hilfe beobachtet der Rechner den Menschen, der vor der Projektionswand steht. Sobald der Akteur die Hände bewegt, reagiert der Rechner – völlig berührungsfrei. „Dazu ermittelt er zunächst einmal die Position der Zeigefinger des Nutzers, deren Bewegung er verfolgt“, erklärt Projektleiter Chojecki. Der Nutzer kann auf Knöpfe deuten oder virtuelle Objekte durch seine Gesten verschieben. Er kann sie durch die „Multipointing Interaktion“, also durch Eingaben mit mehreren Fingern, drehen, vergrößern oder verkleinern. Dazu sind weder spezielle Handschuhe noch eine besondere Markierung nötig. Jeder kann ohne Vorbereitung mit der bloßen Hand das Gerät intuitiv bedienen.

Auf der CeBIT 2008 wird der iPoint Presenter zum ersten Mal anhand eines interaktiven Spiels und eines Photoviewers vorgeführt. Aber er eignet sich für eine Vielzahl weiterer Anwendungen etwa als Ersatz für Touch-Screens an Infoterminals oder zum Bearbeiten und Ordnen von Bildern. „Das Besondere ist, dass die Kommunikation absolut berührungsfrei erfolgt. Deshalb ist das System ideal für Szenarien, in denen kein Kontakt zwischen dem Nutzer und dem Computer bestehen darf oder kann, wie etwa im Operationssaal“, so Chojecki.

Auch für Präsentationen vor großen Auditorien wäre das System ideal: Der Redner könnte auf Maus oder Laser-Pointer verzichten; weiter klicken und wesentliche Infos hervorheben, einfach indem er auf sie zeigt. Denn das System lässt sich auch auf bis zu neun Kameras erweitern. Damit vergrößert sich der Aktionsradius des Nutzers enorm, und er kann beispielsweise auf Messen oder Werbeveranstaltungen auf einer großen Leinwand agieren.

Computersteuerung per Geste

Noch besser aber wäre es, wenn es auch ohne die aufwändige Kameratechnik im Hintergrunds ginge. Wenn die Computer direkt Gesten verstehen könnten. Diese Form der Eingabe würde vieles angenehmer und sicherer gestalten als es heute ist: Im Auto könnte man Radio und Navi leichter bedienen und zu Hause im Fernsehsessel bräuchte man zum Zappen keine Fernbedienung mehr. Eine ganz neue Generation von Videospielen ließe sich realisieren, wenn die Technik die menschlichen Gesten erkennen und interpretieren könnte. Eine Hilfe böte das System auch für körperlich behinderte Menschen: die Interaktion mit dem Computer – ohne Maus und Tastatur.

Damit diese Szenarien so schnell wie möglich Realität werden bringen Forscher vom Fraunhofer-Institut für Digitale Medientechnologie IDMT in Ilmenau Computern nun das Verstehen von Gesten bei. Sie entwickeln ein Verfahren zur automatischen Erkennung von unterschiedlichen Handzeichen. „Wir arbeiten auf der Basis der optischen Mustererkennung“, erklärt Projektleiter Valiantsin Hardzeyeu vom IDMT. „Das Verfahren ist der Art und Weise nachempfunden, wie der Mensch sieht. Wir haben dazu die Vorgänge im menschlichen Sehapparat, vom Einfallen der Photonen auf die Netzhaut bis zur Bearbeitung im visuellen Cortex, in einer Computersimulation modelliert.“

Auf der CeBIT wird ein erster Prototyp vorgestellt, bei dem eine „intelligente“ Kamera an einen Computer mit entsprechender Mustererkennungssoftware angeschlossen ist. Mit der Kamera werden Gesten der Besucher aufgenommen. Die dahinter geschaltete Software analysiert sie und interpretiert die Handzeichen in Steuerbefehle für Maschinen um.

(Fraunhofer-Gesellschaft, 05.03.2008 – NPO)