Ein neues Computerprogramm erweist sich als gewiefter Skizzenleser: Es erkennt selbst krakelige Zeichnungen besser als der durchschnittliche Mensch – und viel besser als herkömmliche Bilderkennungs-Software. Der Grund dafür: Das neuronale Netzwerk ist lernfähig und entnimmt selbst der Reihenfolge der Striche wertvolle Informationen. Das könnte künftigen Touchscreen-Anwendungen zugute kommen.

Wir Menschen nutzen Skizzen schon seit Jahrtausenden – nicht nur in der Kunst, sondern auch, um uns Dinge zu merken oder anderen Informationen zu geben. Was eine Skizze darstellt, ist allerdings nicht immer ganz einfach zu erkennen. Denn je nach Fähigkeit des Zeichners sind sie mehr oder weniger krakelig und abstrakt. Zudem fehlen den einfachen Bleistiftzeichnungen Farben, die ein Erkennen des Dargestellten erleichtern würden.

Wir erkennen nur rund drei Viertel

Kein Wunder also, dass wir die Skizzen anderer nicht immer korrekt identifizieren können. „Eine große Studie mit 20.000 Freihandskizzen aus 250 Kategorien ermittelte eine Trefferquote von rund 73,1 Prozent – das zeigt, dass diese Aufgabe selbst für den Menschen eine Herausforderung ist“, erklären Qian Yu von der Queen Mary University of London und seine Kollegen. Für viele Computerprogramme ist dies sogar noch schwieriger, ihre Trefferquoten liegen meist weit unter denen menschlicher Versuchspersonen.

Doch Yu und seine Kollegen haben nun ein Computerprogramm entwickelt, das erstmals Skizzen besser erkennen kann als der Mensch. Sketch-a-Net ist ein sogenanntes Deep Neural Network – ein mehrschichtiges Netzwerk, in dem einzelne Arbeitsschritte nach Vorbild des Gehirns verknüpft sind. Das neue Programm lernt und erkennt nicht nur die Umrisse und Formen in den Skizzen, es zieht auch wertvolle Informationen daraus, in welcher Reihenfolge die einzelnen Striche gemacht wurden.

Besser als der Mensch

Wie erste Tests ergaben, erkennt Sketch-a-Net zu74,9 Prozent korrekt, was in einer Freihand-Skizze dargestellt ist. Damit liegt seine Trefferquote immerhin 1,8 Prozent höher als die von menschlichen Probanden – ein Rekord für Maschinengehirne. Künstliche neuronale Netze, die speziell für die Erkennung von Fotos entwickelt wurden, schnitten dagegen erheblich schlechter ab: Sie erkannten nur gut 20 Prozent der Skizzen korrekt.

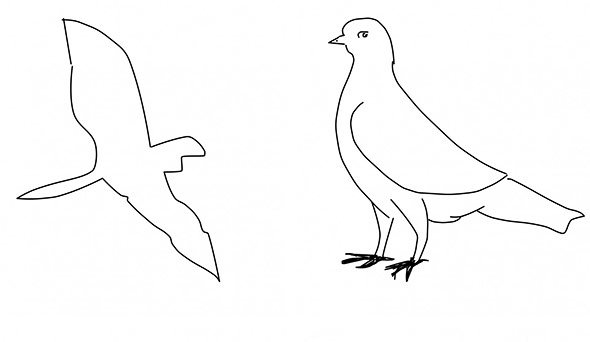

Wenn es um feinere Details ging, lag Sketch-a-Net sogar noch deutlicher vorn als die menschlichen Vergleichspersonen, wie die Forscher berichten. So konnte das Programm beispielsweise bei Vogelskizzen besser erkennen, um welchen Vogel es sich handelte. „Für Abbildungen von Möwen, fliegenden oder stehenden Vögeln und Tauben erreichte Sketch-a-Net eine Trefferquote von 42,5 Prozent, während die Menschen nur 14,8 Prozent schafften“, so Yu und seine Kollegen.

Nützlich für Touchscreens

Nach Ansicht der Forscher könnten Programme nach dem Vorbild von Sketch-a-Net vor allem für Touchscreen-Anwendungen nützlich sein. „Denn mit der Verbreitung von Touchscreens ist das Skizzieren einfacher und verbreiteter geworden – wir können mal eben etwas auf dem Smartphone, dem Tablet oder sogar der Uhr zeichnen“, sagen die Wissenschaftler.

Um diese Skizzen zu erkennen und zuzuordnen, benötigt man entsprechend fähige Programme. „Sie könnten daher eine große Bedeutung für Gebiete wie die Polizeiarbeit, die Touchscreen-Nutzung und die Bildverarbeitung bekommen“, erklärt Koautor Timothy Hospedales von der Queen Mary University. „Letztlich könnten sie uns sogar dabei helfen, die visuelle Wahrnehmung besser zu verstehen.“ (British Machine Vision Conference, 2015, arXiv:1501.07873)

(Queen Mary University of London, 22.07.2015 – NPO)