Dem Gedankenlesen einen Schritt näher: Nur anhand der Gehirnströme erkennt eine neue Software, welche Wörter oder Sätze ein Proband gerade spricht. Das „Brain-to-Text“-Verfahren wertet anhand von zuvor gelernten Sprachmustern die Hirnströme aus und kann so erstmals kontinuierlich gesprochene Laute, Wörter und ganze Sätze rekonstruieren und per Computer als Text wiedergeben, wie Forscher im Fachmagazin „Frontiers in Neuroscience“ berichten.

Das Gedankenlesen ist ein alter Traum des Menschen. Die Vorstellung, dass man ohne zu sprechen direkt über Gedanken kommunizieren kann, fasziniert und ängstigt zugleich. Dank moderner Computertechnik und lernfähiger Algorithmen rückt diese Fähigkeit immer näher. Bereits 2012 war es Forschern gelungen, aus Hirnströmen einzelne von den Probanden gehörte Wörter zu rekonstruieren.

Von Hirnsignalen zum Text

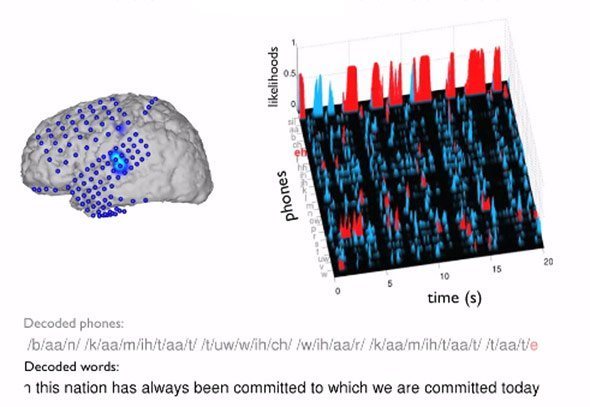

Christian Herff vom Karlsruher Institut für Technologie (KIT) und seine Kollegen sind nun noch einen Schritt weiter gegangen. Sie haben ein Verfahren entwickelt, das erstmals nicht nur einzelne Phrasen, sondern auch kontinuierlich gesprochene Sprache erkennt und in Text transformiert. Das „Brain-to-Text“-System kombiniert Informationen aus dem Cortex des Probanden mit linguistischem Wissen und Algorithmen des maschinellen Lernens, um die wahrscheinlichste Wortsequenz zu extrahieren.

Getestet haben die Forscher ihr System an sieben Epilepsie-Patienten, denen zur Vorbeugung von Anfällen ohnehin bereits einige Elektroden ins Gehirn implantiert worden waren. „Diese elektrocorticografischen Schaltkreise liefern uns die elektrischen Potenziale in einer hohen räumlichen und zeitlichen Auflösung, ohne vom Schädel gefoltert zu werden“, erklären die Herff und seine Kollegen.

Silben als Basis

Damit das Brain-to-Text-System die typischen Hirnstrom-Muster lernen konnte, zeichneten die Forscher zunächst die Signale auf, während die Probanden verschiedene Phrasen und Texte laut vorlasen. Aus der Vielfalt der registrierten Hirnströme isolierten sie dann diejenigen, die in einem engen Zusammenhang zu Sprache und Mundbewegungen stehen.

Anhand dieser Sprachmuster lernte die Software nun, welche Signale welchen Wörtern entsprechen. Das Besondere daran: Das Brain-to-Text-System lernt auch einzelne Silben und Wortteile und kann so selbst unbekannte, aus diesen Silben zusammengesetzte Wörter später erkennen. „Schon mit einem begrenzten Satz an Wörtern in seinem Lexikon kann Brain-to-Text gesprochene Phrasen aus neuralen Daten rekonstruieren“, so die Forscher. Dieses Video erklärt das Prinzip.

Wort-Fehlerraten unter 25 Prozent

Dass dies funktionierte, zeigte ein Test mit den sieben Probanden: Sie sollten dafür erneut Textabschnitte vorlesen, während ihre Gehirnströme abgeleitet wurden. Wie sich zeigte, konnte Brain-to-Text das Gesprochene erstaunlich gut wiedergeben: „Unsere Ergebnisse demonstrieren, dass das System Wort-Fehlerraten von unter 25 Prozent erreichen kann“, berichten Herff und seine Kollegen. Muss die Software neue Wörter nur anhand der Phoneme rekonstruieren, liegt es immerhin in der Hälfte der Fälle richtig.

Noch funktioniert das Brain-to-Text- System nur mit hörbar gesprochener Sprache. Doch nach Ansicht der Forscher könnte dies ein wichtiger erster Schritt sein, um auch gedachte Sprache später einmal auslesen zu können. Dann könnte es beispielsweise mit solchen Systemen möglich werden, mit Locked-In-Patienten zu kommunizieren. Bei diesem Phänomen ist ein Patient zwar bei Bewusstsein, kann aber weder über Bewegungen noch Sprache mit der Außenwelt kommunnizieren. (Frontiers in Neuroscience, 2015; doi: 10.3389/fnins.2015.00217)

(Karlsruher Institut für Technologie, 15.06.2015 – NPO)