Mitte März 2014 stellte Oliver Bierhoff in Hannover Bundeskanzlerin Angela Merkel und dem britischen Premierminister David Cameron den jüngsten Neuzugang der deutschen Fußballnationalmannschaft vor. Der Manager der Elf tat das nicht ohne Grund auf der Computermesse Cebit – denn „der Neue“ ist eine Software.

Immer mehr Daten

Gefüttert mit Daten aus Sensoren, Kameras und Radaranlagen kann sie Fußballspiele und Trainingseinheiten in Echtzeit analysieren. Eines Tages, so die Idee, sollen die gesammelten Erkenntnisse den Ausgang von Turnieren wie der Fußball-WM in Brasilien beeinflussen. Beeindruckt blicken Merkel und Cameron auf einen Bildschirm voller Passquoten, Zweikampfwerte und Laufleistungen. „Der Computer“, erklärt Bierhoff, „wird nicht die Tore schießen, aber uns besser machen.“

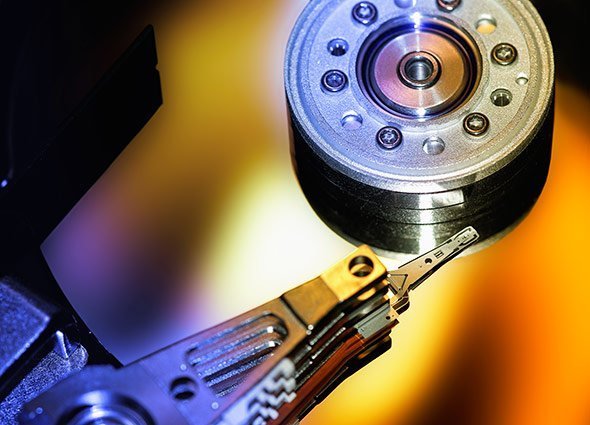

Aber nicht nur im Fußball wird die Analyse riesiger Datensätze dieser Tage als eine Art Wunderwaffe betrachtet. Das Schlagwort „Big Data“ scheint in aller Munde, seit immer mehr Daten auf immer geräumigeren Festplatten schlummern. Allein 2012 entstanden nach Schätzungen eines Speichermedien-Herstellers weltweit 2,8 Zettabyte an Daten – eine Zahl mit 22 Stellen. Bis 2020 könnte das weltweite Datenvolumen gar bis auf 40 Zettabyte anschwellen. Die Menge der Bytes würde damit jene der Sandkörner aller Strände der Erde um das 57-Fache übersteigen.

Von der Stauprävention bis zur optimalen Therapie

Für Konzerne, Regierungen und Wissenschaftler ist diese Aussicht ein Versprechen. Mit immer leistungsstärkeren Superrechnern tauchen sie ein in die Datenflut, um mit Algorithmen in weltweit verstreuten und teilweise vollkommen unzusammenhängenden Datensätzen nach Korrelationen zu fahnden. Großstädte nutzen dieses Data Mining genannte Vorgehen, um den Verkehr auf chronisch verstopften Straßen so zu dirigieren, dass Staus bald der Vergangenheit angehören. Drogerieketten errechnen mit seiner Hilfe, bei welchem Wetter ihre Kunden welche Filiale besuchen.

Die Gesundheitsforschung hofft, durch das Schürfen in Abermillionen Krankenakten eines Tages jedem Patienten die individuell wirksamste Therapie gewähren zu können. Auch in Deutschland rückt Big Data deshalb zunehmend in den Blick der Wissenschaft. Doch trotz aller damit verbundenen Hoffnungen bleibt Forschern hierzulande der Zugang zu vielversprechenden Datenbergen häufig versperrt.

Karl-Heinz Karisch, David Schelp / Leibniz Journal

Stand: 11.07.2014